Habitat居家机器人 3.0 来了:社交智能机器人之路的下一个里程碑

当我们想到人工智能助手时,我们通常会想到基于网络的聊天机器人或固定式智能扬声器。在 FAIR,我们一直在追求普遍智能的具体人工智能代理,它们可以感知环境并与其交互,与人类伙伴安全地共享该环境,并在数字和物理世界中与这些人类伙伴进行沟通和协助。我们正在朝着全天佩戴增强现实 (AR) 眼镜的未来愿景迈进,其中包括情境化的 AI 驱动界面和助手,为您提供全天帮助。我们还致力于改进社交智能机器人背后的技术,这些机器人将帮助完成日常琐事,同时适应和个性化人类伙伴的偏好。这项机器人工作主要侧重于深入嵌入式系统,以构建最佳的下一代 AR 和 VR 体验。

在物理硬件(无论是机器人还是 AR 眼镜)上与真人一起训练和测试社交 AI 代理存在可扩展性限制,需要建立标准化基准测试程序,这会增加复杂性,并且可能会带来安全问题。这就是为什么我们开发了一套新的机器人研究工具,涵盖模拟器、数据集和包含硬件和软件的经济技术堆栈,使这项研究变得更容易、更快、更经济。

今天,我们宣布在开发社交人工智能代理方面取得的三项重大进展,这些人工智能代理可以在日常生活中与人类合作并提供帮助:

Habitat 3.0:最高质量的模拟器,支持机器人和人形化身,并允许在类似家庭的环境中进行人机协作。经过 Habitat 3.0 训练的人工智能代理学会在清理房屋等日常任务中寻找人类伙伴并与人类伙伴协作,从而提高人类伙伴的效率。这些人工智能代理使用模拟人机循环评估框架与真实的人类伙伴进行评估,该框架也随 Habitat 3.0 一起提供。栖息地合成场景数据集 (HSSD-200):艺术家创作的 3D 数据集,包含 211 个场景中 466 个语义类别的 18,000 多个对象。HSDD-200 是同类中质量最高的数据集,可以使用比之前数据集少两个数量级的场景来训练导航代理,使其具有与物理世界 3D 重建场景相当或更好的泛化能力。HomeRobot:一种经济实惠的家庭机器人助手硬件和软件平台,机器人可以在模拟和物理世界环境中执行开放词汇任务。

人居3.0

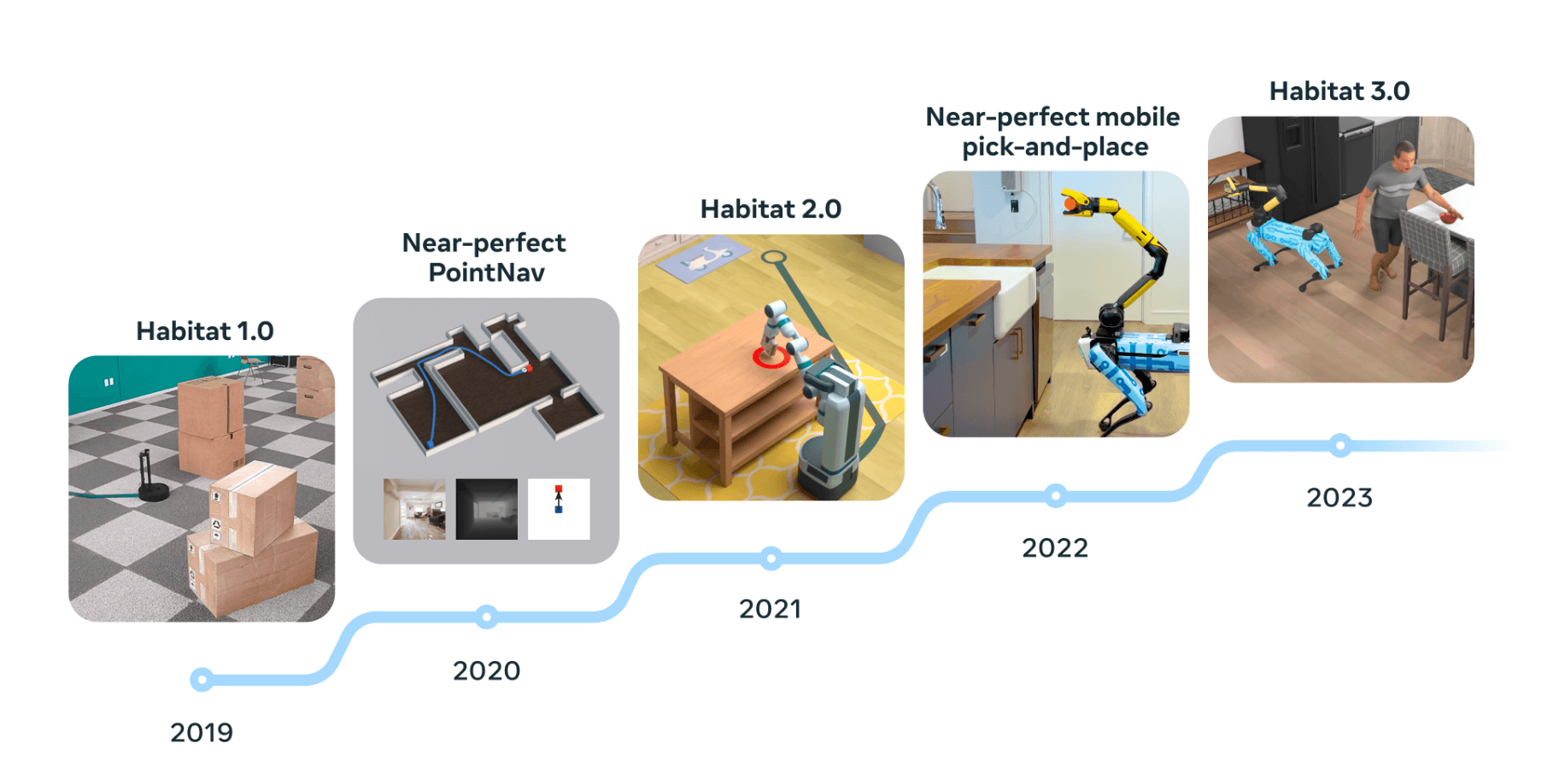

为了快速提升机器人能力,我们在模拟器中开发和测试新的算法和模型,然后将它们转移到物理机器人上。多年来,我们在栖息地模拟器方面取得了长足的进步。Habitat 1.0训练虚拟机器人在物理世界房屋的 3D 扫描中以超过每秒 10,000 步的速度 (SPS) 进行导航。Habitat 2.0引入了交互式环境(例如,可以拾取的物体、可以打开的抽屉)和训练有素的虚拟机器人,通过重新排列物体来清理房子。

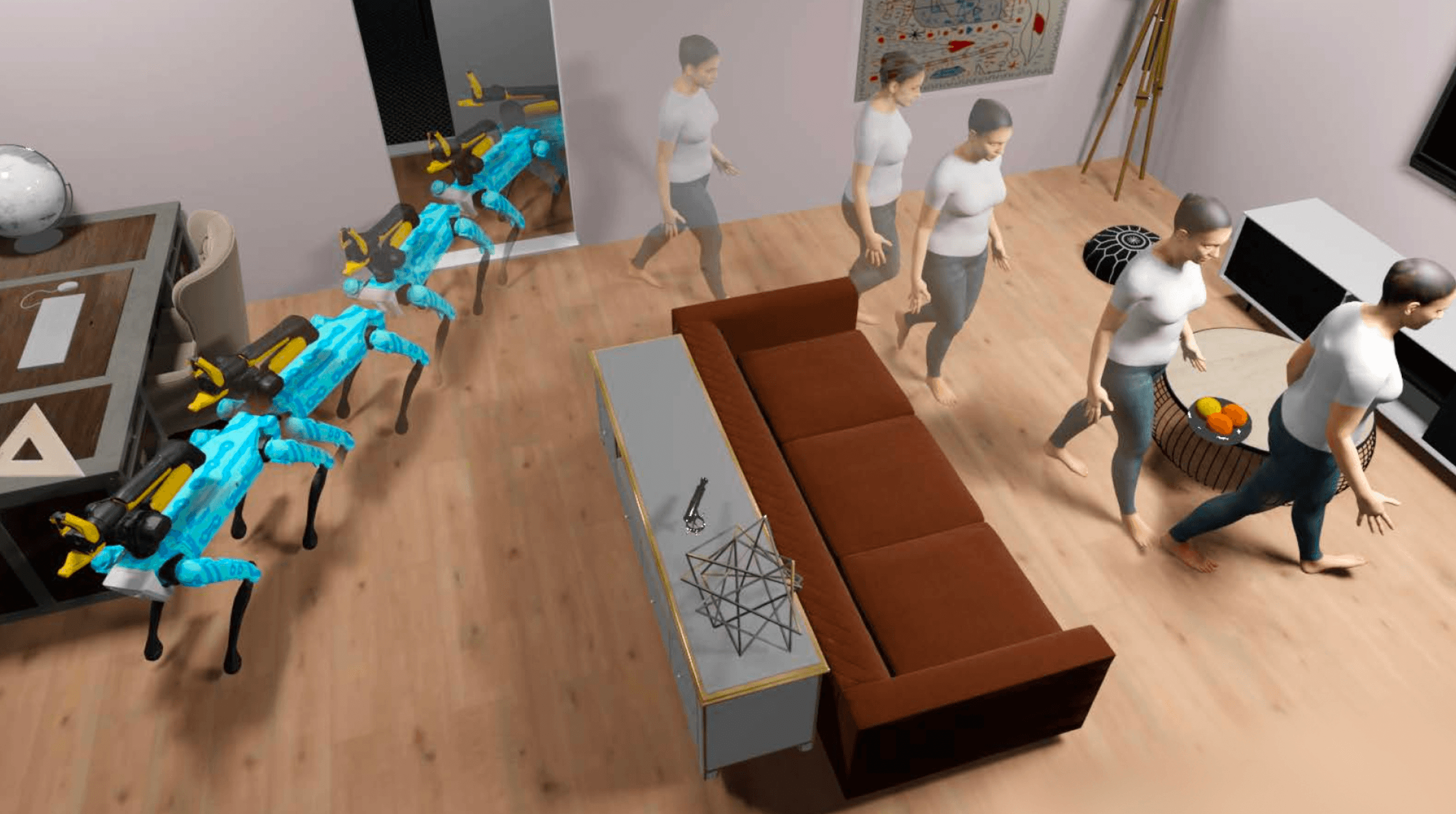

Habitat 3.0 建立在这些进步的基础上,并支持机器人和人形化身,以实现人机协作完成日常任务(例如,整理客厅、在厨房准备食谱)。这为在多样化、现实且视觉和语义丰富的任务中人机协作的研究开辟了新的途径。Habitat 3.0 还支持具有逼真外观、自然步态和动作的人类化身,以模拟逼真的低级和高级交互。这些人形化身可以通过学习策略以及使用人机交互界面的真人来控制。该界面可以支持不同的媒体,例如通过键盘和鼠标以及通过 VR 耳机进行控制。这种人类和机器人在模拟环境中的共存使我们第一次能够在类似家庭的环境中学习机器人人工智能策略,并在类似家庭的环境中执行日常任务,并通过真实的人类在环中对其进行评估。这在几个方面都很重要:

强化学习算法通常需要数百万次迭代才能学习有意义的东西,因此在物理世界中进行这些实验可能需要数年时间。在模拟中,它们可以在几天内完成。在物理世界的不同房屋中收集数据是不切实际的,因为这需要将机器人移动到不同的地方,设置环境等。在模拟中,我们可以在几分之一秒内改变环境并开始在新的环境中进行实验环境。如果模型训练不当,机器人就有可能破坏环境或伤害现实世界中的人们。模拟使我们能够在将这些方法部署到物理世界之前在安全的环境中对其进行测试,以帮助减轻这些安全问题。当今最先进的人工智能模型需要大量数据来进行训练。模拟使我们能够轻松地扩大数据收集规模,而在物理世界中,它可能非常昂贵且缓慢。

我们还提出了两项高度相关的任务和一套基线,以在社交人工智能领域建立基准。第一项任务是“社交重新安排”,涉及机器人和人形化身协作执行一系列拾取和放置任务,例如清理房子。在这项任务中,机器人和人类必须协调他们的行动以实现共同的目标。这种智能行为源于大规模的模拟训练。第二个任务是社交导航,涉及机器人在保持安全距离的同时定位和跟踪人。

我们相信 Habitat 3.0 是第一个支持在多样化、真实的室内环境中进行人机交互任务大规模训练的模拟器。这种训练会在我们的学习策略中产生紧急的协作行为,例如在狭窄的走廊里给人类伙伴让路,以及有效地分割任务以比人类单独完成更快地完成任务。

栖息地合成场景数据集 (HSSD-200)

3D 场景数据集对于在模拟环境中训练机器人至关重要。虽然有许多模拟 3D 环境数据集允许我们扩展训练数据,但我们不了解数据集规模(场景数量和总场景物理尺寸)和数据集真实性(视觉保真度和与物理的相关性)之间的权衡-世界统计)。HSSD-200 是一个合成 3D 场景数据集,与之前的数据集相比,它更接近地反映物理场景。它由代表实际内部的 211 个高质量 3D 场景组成,并包含来自 466 个语义类别的 18,656 个物理世界对象模型。

HSSD-200 在多个方面与之前的工作有所不同。它提供高品质、完全由人工创作的 3D 内饰。它包括与WordNet本体相对应的细粒度语义分类。其资产压缩可实现高性能的嵌入式 AI 模拟。它的场景是使用 Floorplanner 网络室内设计界面设计的。布局主要是对实际房屋的再现。单个对象由专业 3D 艺术家创建,在大多数情况下,与特定品牌的实际家具和电器相匹配。

我们的实验表明,规模较小但质量较高的 HSSD-200 数据集导致 ObjectGoal 导航 (ObjectNav) 代理的性能与在更大数据集上训练的代理相当。我们发现,我们可以使用比之前数据集少两个数量级的 HSSD-200 场景来训练导航代理,使其具有与物理世界 3D 重建场景相当或更好的泛化能力。事实上,与在 10,000 个 ProcTHOR 场景上训练的智能体相比,在 122 个 HSSD-200 场景上进行训练可以使智能体更好地泛化到 HM3DSem [43] 物理世界场景。

家庭机器人

通用、共享的平台一直是机器学习进步的重要组成部分,但机器人技术大多缺乏这些平台,因为复制和扩展硬件结果很困难。我们为可重复机器人研究平台确定了三个目标:

激励性的北极星:它必须提供一些指导性的北极星任务,这些任务可以激励研究人员,帮助塑造他们的工作,并允许对有趣的现实问题的各种方法进行比较;软件能力:它应该提供许多抽象接口,使机器人更容易用于各种任务,包括导航和操纵;和社区:我们应该激励人们参与、使用代码库,并尝试围绕它建立一个社区。

作为北极星,我们定义了开放词汇移动操作(OVMM) ——也就是说,在任何看不见的环境中拾取任何物体并将其放置在指定位置。这需要非常强大的长期感知和场景理解,这对于各种任务都很有用。

为了推动这一领域的研究,我们引入了HomeRobot库,该库实现了支持 Hello Robot 的 Stretch 的导航和操作功能。HomeRobot 有两个组件:一个模拟组件,在新的高质量多房间家庭环境中使用大量多样化的精选对象集;另一个是物理世界组件,为低成本的 Hello Robot Stretch 提供软件堆栈。除了波士顿动力公司的地点外,为了鼓励跨实验室复制物理世界实验。

HomeRobot 被设计为用户友好的软件堆栈,可以快速设置机器人以进行立即测试。我们的软件堆栈的主要功能包括:

可转移性:每个任务的模拟和物理世界设置之间的统一状态和动作空间,提供了一种通过高级动作空间(例如,预先制定的抓取策略)或低级连续联合控制来控制机器人的简单方法。模块化:感知和动作组件支持高级状态(例如,语义地图、分段点云)和高级动作(例如,前往目标位置、拾取目标对象)。基线代理:使用这些功能为 OVMM 提供基本功能的策略,以及用于构建其他团队可以构建的更复杂代理的工具。

我们还介绍了 HomeRobot OVMM 基准,其中代理导航家庭环境以抓取新物体并将它们放置在目标容器中或目标容器上。我们实施了强化学习和启发式(基于模型)基线,并展示了导航和位置技能从模拟到物理世界转移的证据。我们的基线在现实世界中实现了 20% 的成功率。我们正在举办Neurips 2023 竞赛,以鼓励采用并围绕我们的新平台发展社区。

下一步是什么?

近年来,实体人工智能研究领域主要集中在静态环境的研究——假设环境中的物体保持静止。然而,在人类居住的物理环境中,事实并非如此。我们对社交智能机器人的愿景超越了当前的范式,考虑了人类和机器人相互作用的动态环境以及他们周围的环境。人类和机器人之间的交互带来了新的问题和可能性,例如协作、通信和未来状态预测。

自 2019 年开源 Habitat 1.0 以来,虽然我们在社交智能机器人的愿景方面取得了相当大的进展,但仍有重要的工作要做。在我们研究的下一阶段,我们将使用 Habitat 3.0 模拟器来训练我们的 AI 模型,以便这些机器人能够帮助他们的人类伙伴并适应他们的偏好。我们将使用 HSSD-200 与 Habitat 3.0 结合大规模收集人机交互和协作的数据,以便我们可以训练更强大的模型。我们将专注于将模拟中学到的模型部署到物理世界中,以便我们可以更好地衡量它们的性能。